Les humains qui programmaient l’IA… et si c’était l’inverse? – Episode 1

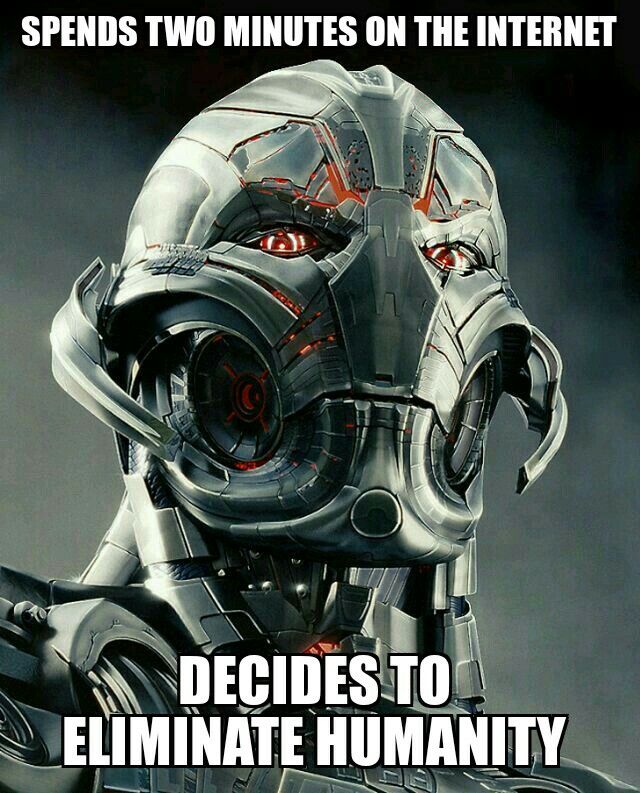

Dans la culture populaire, un leitmotiv revient souvent : un ou plusieurs scientifiques brillants créent une Intelligence Artificielle (IA) qui échappe à leur contrôle et décide de conquérir le monde. Pour illustrer, quelques exemples de films sur cette longueur d’onde : de « 2001 : a Space Odyssey » en 1968, « WarGames » en 1983 ou « The Terminator » en 1984 aux plus récents, comme « Her » en 2013 ou « Avengers : l’ère d’Ultron » en 2015. Cependant la vraie vie ce n’est pas du cinéma, et la réalité de l’ingénierie en IA reste très différente de la vision hollywoodienne. Mais concrètement, à quoi sert l’IA ? Pour avoir une vision plus éclairée sur cette question et son “omniprésence”, je vous propose de suivre une journée dans le quotidien de Léa, à travers des exemples bien réels. Spoiler alert : finalement, conquérir le monde, c’était l’option sympa.

La journée de Léa commence

Un peu de musique pour bien se réveiller

Il est 7h. Léa entrouvre un œil, éteint vite son réveil, et lance, de sa voix encore endormie « Alexa, mets-moi un peu de jazz ». L’assistance vocale, c’est tellement pratique !

Les actualités customisées

Léa, debout cette fois, prend son café (elle ne peut pas s’en passer), et lit son fil d’actualités sur son smartphone (ça non plus, elle ne peut pas s’en passer). Ses « actualités », tout comme les vôtres et les miennes, sont personnalisées en fonction des lectures précédentes, du pays, de l’âge, du genre, de la catégorie socio-professionnelle. D’un côté, ceci présente un côté très pratique. Il y a tellement d’informations aujourd’hui qu’on est facilement submergés. Voir juste les informations qui nous sont pertinentes nous facilite beaucoup la vie. Mais de l’autre côté, il faut avoir conscience que les informations présentées sont filtrées spécialement pour chacun d’entre nous. Parfois, en fonction de nos opinions politiques, un même évènement va nous être présenté à travers un prisme qui influencera notre interprétation des faits. C’était déjà le cas, selon qu’on lise le Figaro ou le Monde. Mais aujourd’hui la personnalisation de l’information va bien au-delà et, surtout, dans les deux sens : nos goûts et opinions sont identifiées, et les informations présentées sont fonctions de ses goûts et opinions. Mais ces algorithmes de filtrage déterminent littéralement les informations que nous consommons, et qui façonnent aussi petit à petit nos opinions. Il s’agit d’une sorte de censure, voire de manipulation. Léa est une jeune femme et simplement par ce fait, les algorithmes placent les régimes minceurs et les des programmes de sport pour muscler les fessiers dans ces centres d’intérêt. À force d’en voir tous les jours dans son champ de vision, combien de temps avant que Léa se dise, apparemment d’elle-même, qu’elle a envie de suivre un challenge « lockdown body » de 30 jours ?

Les algorithmes qui filtrent les informations auxquelles nous avons accès sont forcément optimisés pour quelque chose par leurs concepteurs. On ne peut pas demander à un algorithme l’information « la meilleure » sans spécifier ce qu’on entend par ce terme. Et en tant qu’utilisateurs, on peut que se poser des questions sur ce à quoi correspond « le meilleur » pour les concepteurs. La meilleure information peut être celle qui maximise notre temps de présence sur le site : plus on y passe de temps, et plus il y a de chances qu’on finisse par acheter les produits promus par les influenceurs ou les publicités présentées en périphérie de notre champ de vision. La meilleure information peut aussi être celle qui véhicule le mieux un message sous-jacent. Par exemple, (spoiler), les personnes qui sont satisfaites de leur physique n’achètent pas de produits minceur. Il faut donc créer le besoin pour pouvoir vendre la cure.

Par ailleurs, à force de ne voir que des informations qui confortent notre vision du monde, elle est renforcée et nous pouvons avoir l’impression que notre vision est la seule vision valable – après tout, toutes les informations que l’on lit nous le prouvent ! Et ainsi, un jour à la fois, nous perdons petit à petit les nuances, les détails, nous n’entendons plus les voix des personnes qui ne pensent pas comme nous, parfois jusqu’à obtenir une vision du monde assez simpliste et radicale. Ce phénomène porte le nom de chambre d'écho médiatique – à force de personnaliser, ce sont nos propres pensées, désirs et opinions qui nous sont renvoyées.

D’où l’intérêt d’interagir quelquefois avec des vraies personnes humaines, même si c’est tonton Jean-Eude qui ne parle que de son boulot où mamie Lucine qui vous demande des nouvelles de votre ex à chaque fois, ou encore Nicolas, le voisin du palier qui s’est découvert une passion pour le violon nocturne. Sans forcément être agréable, cela permet de prendre un peu de recul et de sortir de sa bulle.

RDV matinal à la banque

Léa est en location depuis un moment et commence à songer à acheter son propre appartement. Faut-il encore connaître ses capacités d’emprunt. Elle a donc pris RDV (en visio, hein) avec son conseiller bancaire pour avoir une estimation du montant maximal de ce projet.

Pour décider d’accorder ou non le prêt, ainsi que son taux et ses conditions (hypothèque, assurance, etc.) les banques utilisent des algorithmes d’intelligence artificielle pour estimer le risque du dossier, ou score bancaire. Ce score représente, quelque part, à quelle point on peut faire confiance à Léa. Plus le score est haut, et meilleures seront les conditions du prêt. À l’inverse, si le score est en-dessous d’un certain seuil, la banque va peut-être même refuser sa demande.

Le score est calculé en fonction des données personnelles (type de poste occupé, âge, catégorie socio-profesionnelle, etc.) et, si la demande est faite dans une banque où vous avez déjà un compte, de votre historique de transactions. Dans tous les cas, le but de ce scoring est de permettre à la banque d’évaluer au mieux le risques pour éviter de perdre de l’argent.

Après, en fonction des données dont on dispose, on peut aller jusqu’à créer un score social, pour évaluer la confiance qu’on peut donner à un individu dans une société. Les individus au score élevé auront des privilèges, des bonus pour avoir des offres de prêt avantageuses, un accès facilité à l’éducation, au marché de l’emploi et au système de santé, ainsi que pour voyager. Les citoyens avec un score bas ne pourront même pas acheter des billets de train. Non-non, ce n’est pas épisode de Black Mirror, mais une réalité dans certains endroits de la planète.

Filtres à CV

Léa, en dehors de son café matinal, de ses RDV persos et de son goût prononcé pour le jazz, travaille dans le recrutement. Elle travaille au sein d’une équipe d’une entreprise en pleine croissance, qui reçoit beaucoup de candidatures. Beaucoup-beaucoup de candidatures. Pour pouvoir gérer un tel flux, il faudrait que Léa passe maximum 15 secondes par candidature, ce qui est très peu productif, car il est impossible de se faire une bonne idée sur l’adéquation du profil du candidat et du poste proposé en aussi peu de temps. L’intelligence artificielle vient à la rescousse ! Des algorithmes de traitement de texte avancés permettent non seulement de détecter des mots clés dans un CV, mais de classer les mots par catégories en fonction de leur sens sémantique. Pour entraîner cet algorithme, on peut, par exemple, utiliser la base de données des employés passés et actuels de l’entreprise. En analysant l’intitulé de poste d’un employé et son CV, l’algorithme déterminera les mots pertinents pour ce poste. Ainsi, par exemple, l’algorithme apprendra à reconnaître les mots-clés « Java Script », « .NET » ou « PHP » comme pertinents pour un poste de développeur Web. Finalement, l’algorithme fera une pré-sélection de « bons » CVs afin de présenter à Léa une liste de candidatures filtrée beaucoup plus réduite et plus pertinente.

Cependant, en utilisant ce genre d’algorithmes il faut rester extrêmement vigilant au biais d’apprentissage. Les algorithmes de machine learning n’ont aucune imagination et esprit critique. Supposons que dans laquelle travaille Léa, 90% des ingénieurs Web actuels soient des hommes. Alors l’algorithme pourra être biaisé contre le CV d’une femme : en effet, si on regarde la base de données sans trop réfléchir, on peut avoir l’impression que le sexe soit un « bon » facteur discriminant. De la même manière, sans supervision humaine, un algorithme peut développer des biais vis-à-vis de l’âge, de l’éducation ou d’autres facteurs qu’on ne peut décrire que comme discriminatoires. Heureusement, on peut corriger ces erreurs. Dans cette vidéo, Andrew Ng aborde cette problématique et les solutions existantes pour y remédier.

Sur ce, la matinée de Léa se termine et il est bientôt l’heure de la pause déjeuner, que Léa va passer en visio avec ses collègues. Mais ce sera pour le prochain épisode!

Retour aux articles